学习

知识图谱

lamda表达式

一元函数微分学

笔记

执行系统命令

ux

网络运维

st-link

vscode

相机参数

Linux基础指令

paas

恢复显示屏异常显示的方法

游戏策划

skill command

假设检验

TS工时表

procast

wireshark

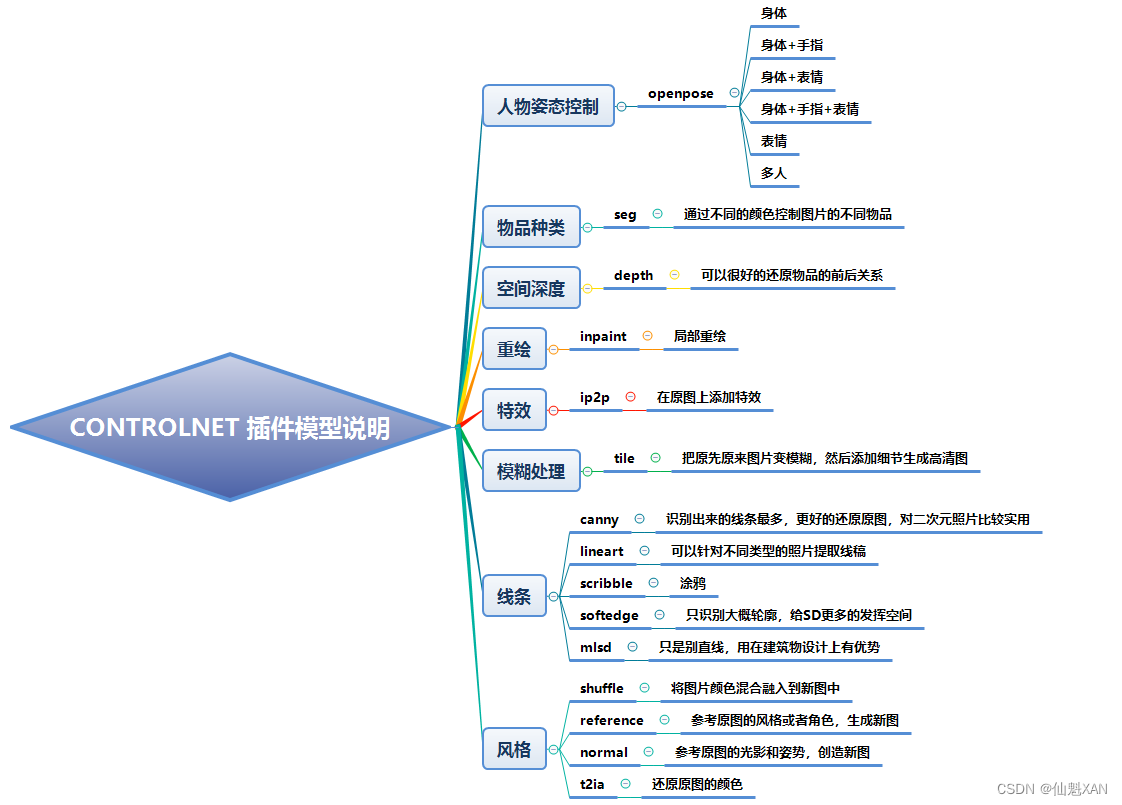

ControlNet

2024/4/12 10:49:02AI - AI绘画的精准控图(ControlNet)

一、介绍

在上一篇 《AI - stable-diffusion(AI 绘画)的搭建与使用》 中, 介绍了 SD 的环境搭建与使用,搭配各种特色模型文件,SD 的文生图功能就可以根据我们输入的提示词(Prompt),绘制出各种各样的精美图…

Stable Diffusion基础:ControlNet之图片高仿效果

今天继续给大家分享AI绘画中 ControlNet 的强大功能,本次的主角是 Reference,它可以将参照图片的风格迁移到新生成的图片中,这句话理解起来很困难,我们将通过几个实例来加深体会,比如照片转二次元风格、名画改造、AI减…

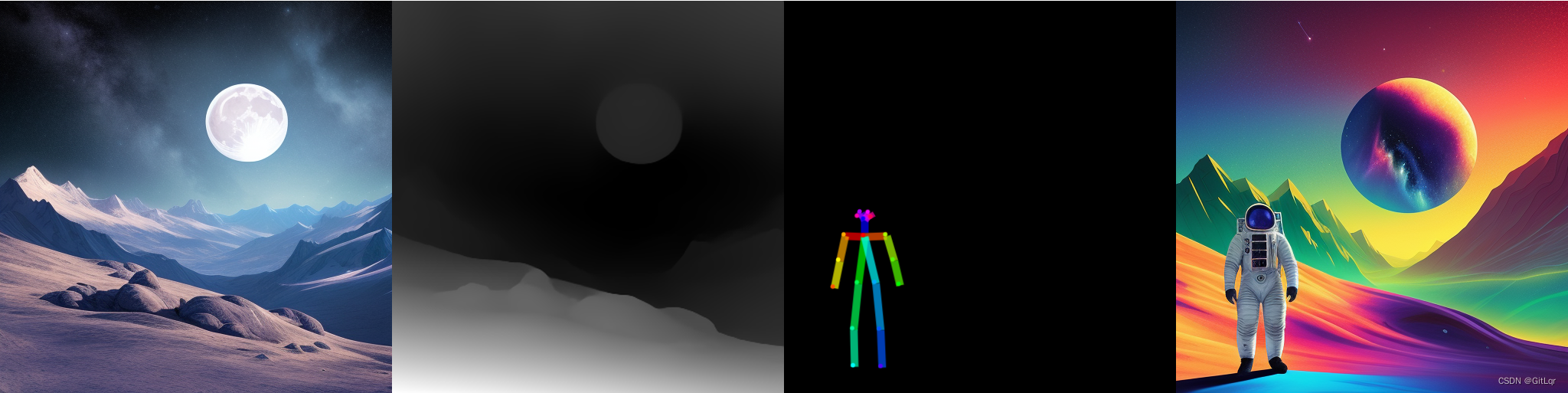

Stable Diffusion 绘画入门教程(webui)-ControlNet(深度Depth)

上篇文章介绍了线稿约束,这篇文章介绍下深度Depth 文章目录 一、选大模型二、写提示词三、基础参数设置四、启用ControlNet 顾名思义,就是把原图预处理为深度图,而深度图可以区分出图像中各元素的远近关系,那么啥事深度图…

Stable Diffusion 绘画入门教程(webui)-ControlNet(Shuffle)

Shuffle(随机洗牌),这个预处理器会把参考图的颜色打乱搅拌到一起,然后重新组合的方式重新生成一张图,可以想象出来这是一个整体风格控制的处理器。

那么问题来了,官方为啥会设计个这样的处理器呢,主要是给懒人用的&am…

ControlNet: 控制扩散模型的魔法

出品人:Towhee 技术团队

作者:王翔宇

从去年以来 AIGC 的技术不断冲击人们的想象力,针对图片的扩散模型(midjourney 和 stable diffusion)已经可以在给于 prompt 下生成非常吸引人的图像,但是如果希望以别…

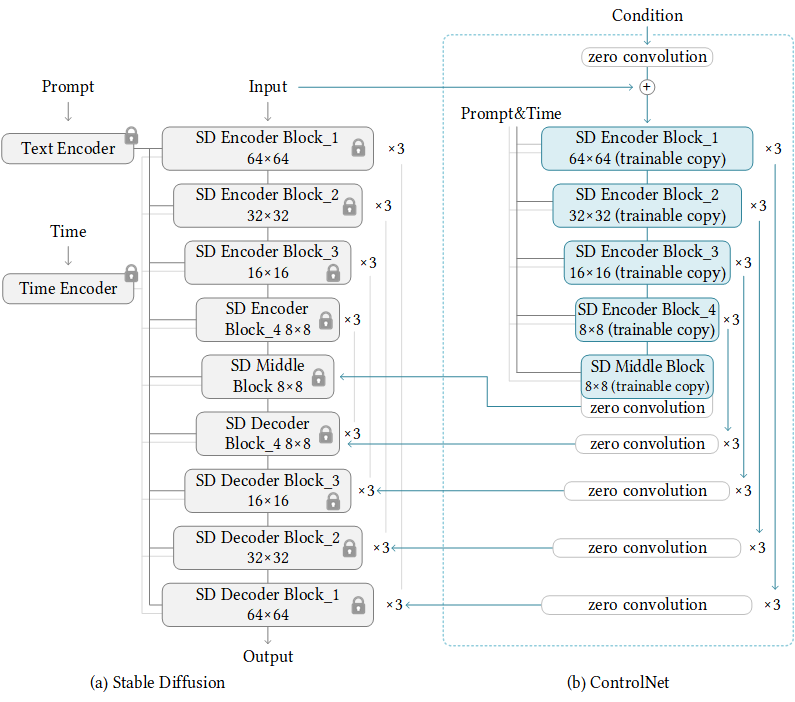

ControlNet原理及应用

《Adding Conditional Control to Text-to-Image Diffusion Models》 目录

1.背景介绍

2.原理详解

2.1 Controlnet

2.2 用于Stable Diffusion的ControlNet

2.3 训练

2.4 推理

3.实验结果

3.1 定性结果

3.2 消融实验

3.3 和之前结果比较

3.4 数据集大小的影响

4.结…

这二维码也太美了吧!利用AI绘画[Stable Diffusion的 ControlNet]生成爆火的艺术风格二维码

文章目录 引子爆火的艺术二维码这种艺术二维码是如何制作出来的 ControlNet 介绍ControlNet的限制条件边缘检测示例人体姿态检测示例使用Canny边缘检测和Openpose有什么区别? 安装稳定扩散控制网ControlNet安装ControlNet更新ControlNet扩展 如何使用Stable Diffusi…

【扩散模型】ControlNet从原理到实战

ControlNet从原理到实战 ControlNet原理ControlNet应用于大型预训练扩散模型ControlNet训练过程ControlNet示例1 ControlNet与Canny Edge2. ControlNet与Depth3. ControlNet与M-LSD Lines4. ControlNet与HED Boundary ControlNet实战Canny Edge实战Open Pose 小结参考资料 Cont…

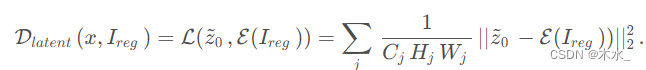

读论文:DiffBIR: Towards Blind Image Restoration with Generative Diffusion Prior

DiffBIR 发表于2023年的ICCV,是一种基于生成扩散先验的盲图像恢复模型。它通过两个阶段的处理来去除图像的退化,并细化图像的细节。DiffBIR 的优势在于提供高质量的图像恢复结果,并且具有灵活的参数设置,可以在保真度和质量之间进…

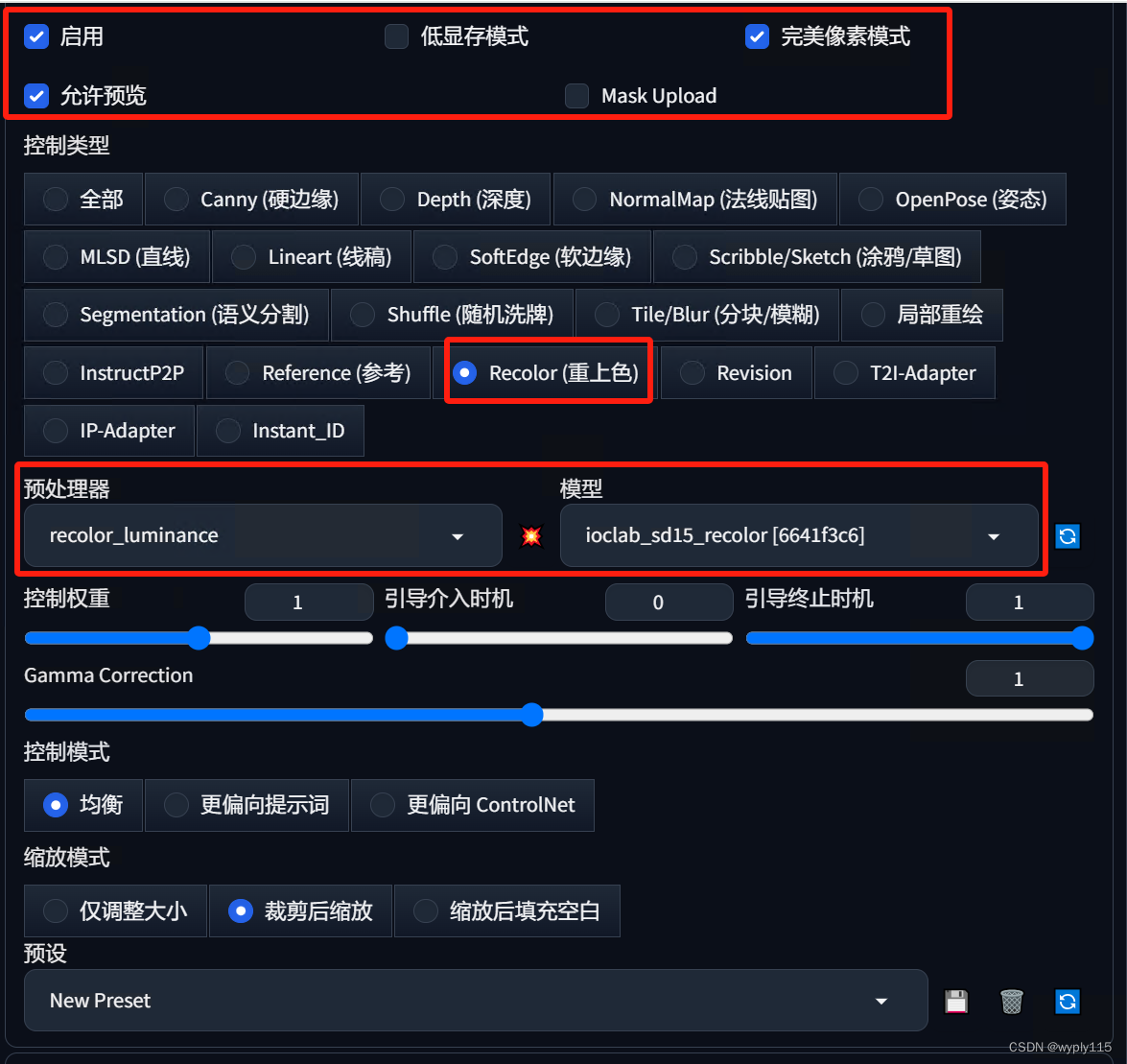

Stable Diffusion 绘画入门教程(webui)-ControlNet(Recolor)

Recolor,顾名思义就是重上色的意思,很明显能想到的用法就是老照片上色,也就是老照片修复,看下效果吧(左边为老旧照片,右边为重上色效果): 当然除了这种玩法,也可以局部修…

stable-diffusion-webui的介绍与使用——Controlnet1.1

源码地址:https://github.com/lllyasviel/ControlNet | 最新版本 controlnet-v1.1 论文地址:2302.Adding Conditional Control to Text-to-Image Diffusion Models 扩展UI地址(需先安装sd-webui):https://github.com/M…

Stable Diffusion 绘画入门教程(webui)-ControlNet

ControlNet可以说在SD里有着举足轻重的地位,如果没有ControlNet,sd的可玩性和实用性将大大降低。

前面几篇文章介绍了 提示词 和 lora,本篇文章介绍sd里最关键的第三个要素–ControlNet 文章目录 一、它具体能干啥1、艺术字2、改变姿态3、其…

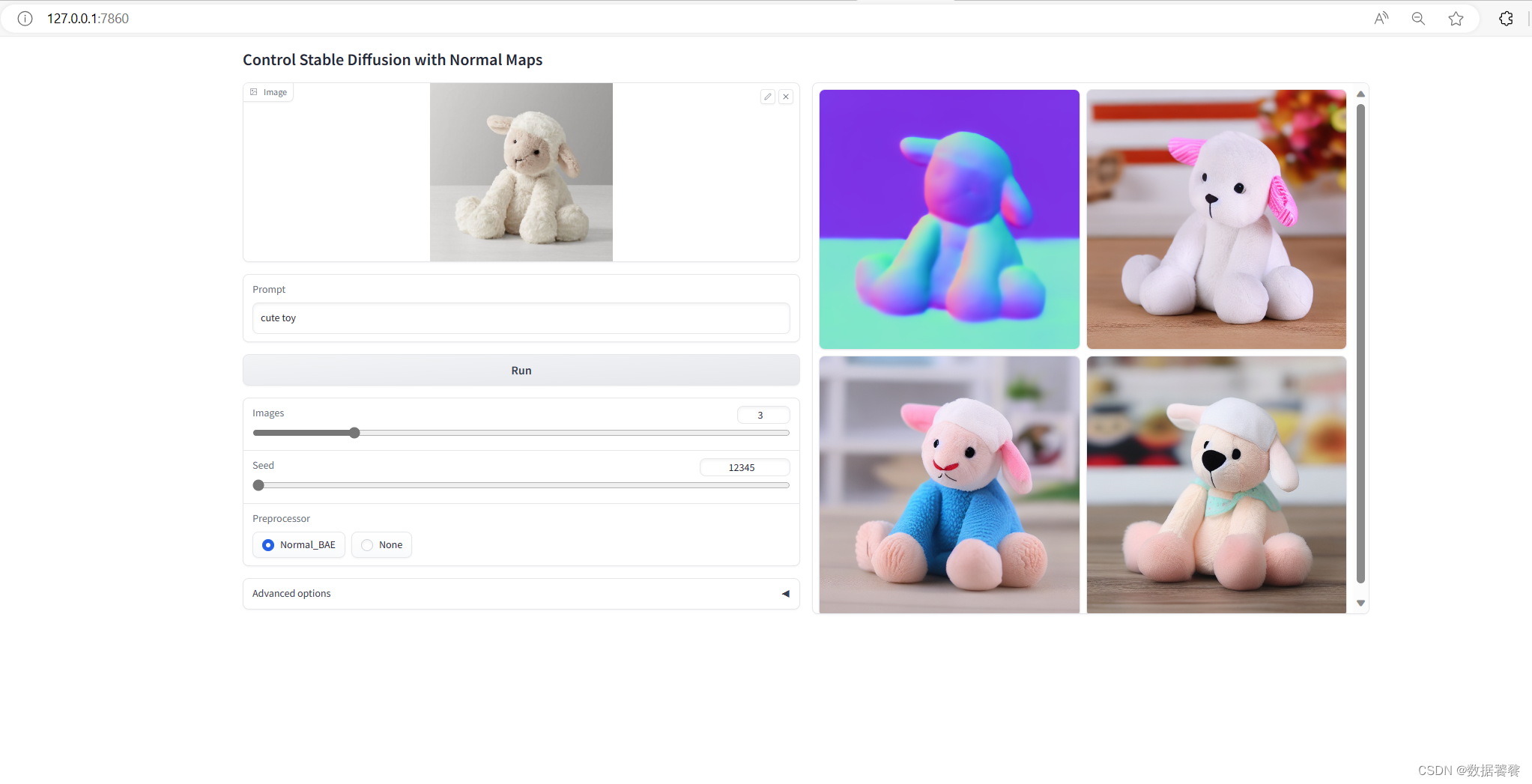

【AIGC专题】Stable Diffusion 从入门到企业级应用0414

一、前言

本文是《Stable Diffusion 从入门到企业级应用实战》系列的第四部分能力进阶篇《Stable Diffusion ControlNet v1.1 图像精准控制》的第0414篇 利用Stable Diffusion ControlNet 法线贴图模型精准控制图像生成。本部分内容,位于整个Stable Diffusion生态体…

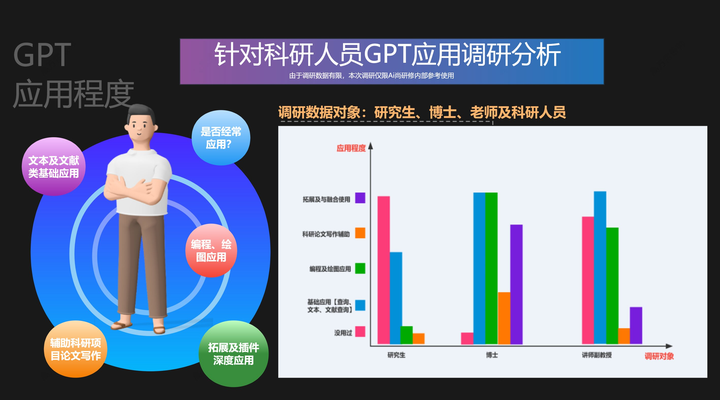

如何使用GPT引领前沿与应用突破之GPT4科研实践技术与AI绘图

GPT对于每个科研人员已经成为不可或缺的辅助工具,不同的研究领域和项目具有不同的需求。例如在科研编程、绘图领域: 1、编程建议和示例代码: 无论你使用的编程语言是Python、R、MATLAB还是其他语言,都可以为你提供相关的代码示例。 2、数据可…

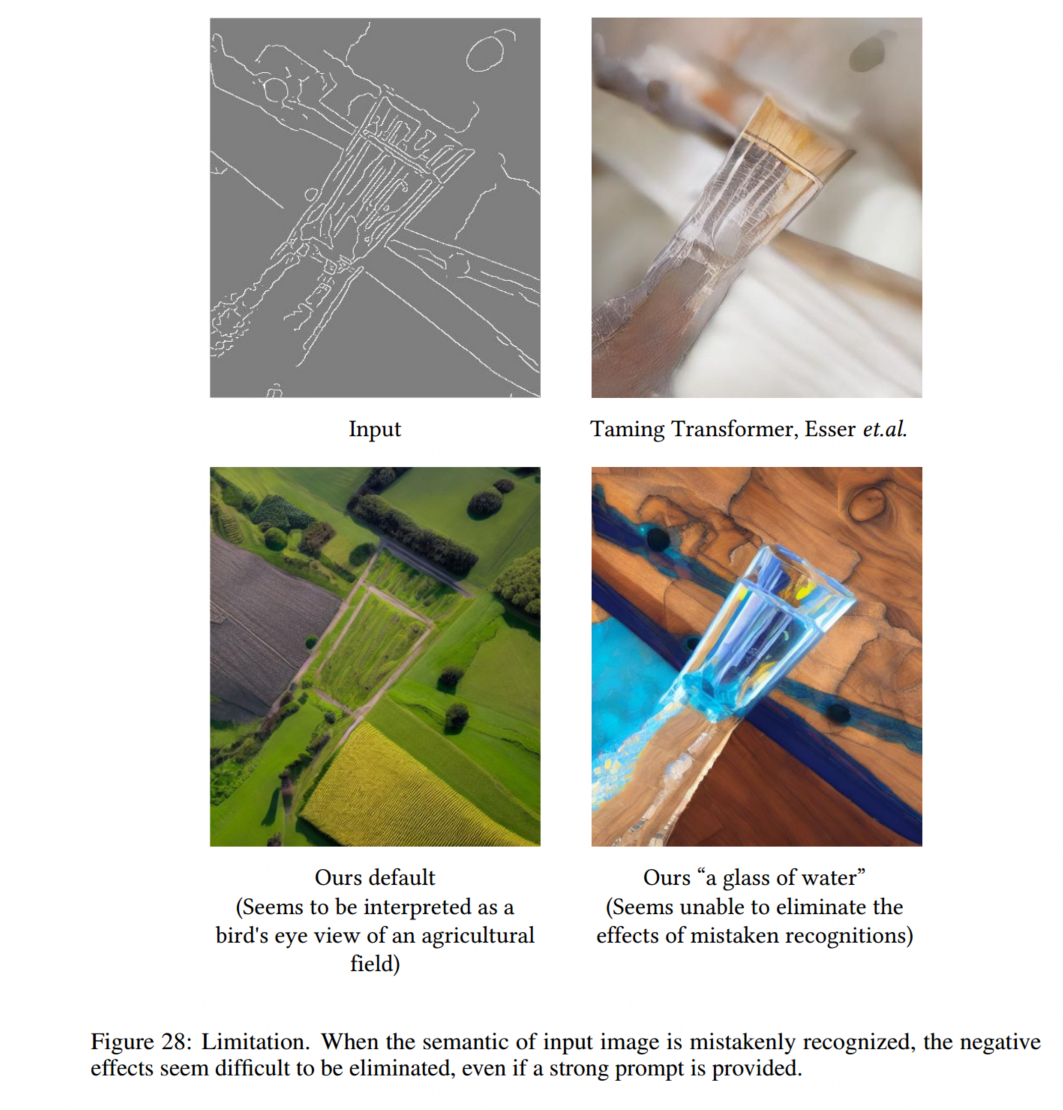

【深度学习】AIGC ,ControlNet 论文,原理,训练,部署,实战,教程

论文:https://arxiv.53yu.com/pdf/2302.05543 代码:https://github.com/lllyasviel/ControlNet

得分几个博客完成这个事情的记录了,此篇是第一篇,摘录了一些论文内容。ControlNet 的原理极为朴实无华(对每个block添加…

Stable Diffusion 从入门到企业级应用010

一、前言

本文是《Stable Diffusion 从入门到企业级应用实战》系列的第四部分能力进阶篇《Stable Diffusion ControlNet v1.1 图像精准控制》的第010篇 利用Stable Diffusion ControlNet 法线贴图模型精准控制图像生成。本部分内容,位于整个Stable Diffusion生态体…

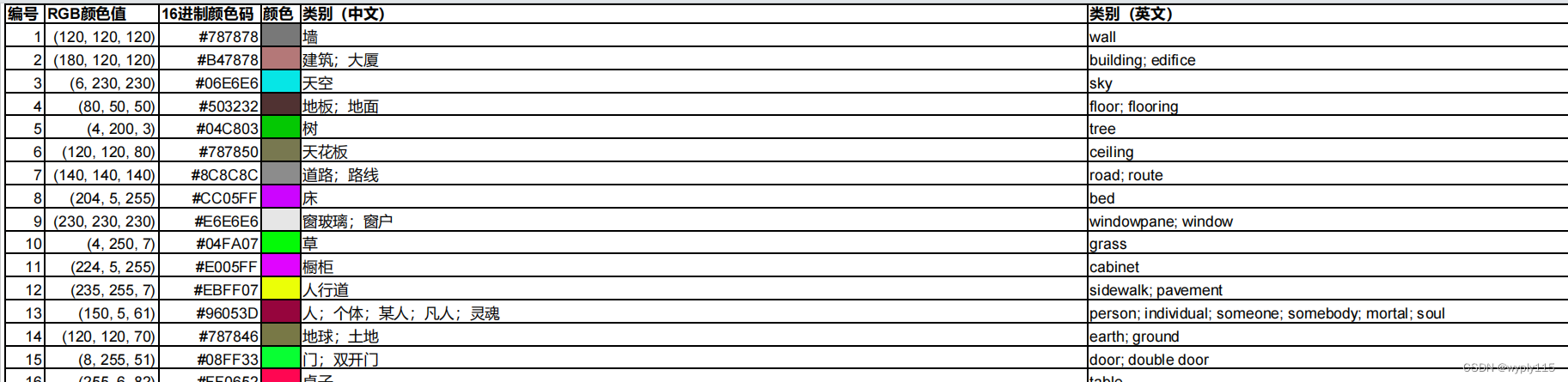

Stable Diffusion 绘画入门教程(webui)-ControlNet(Seg)

上篇文章介绍了深度Depth,这篇文章介绍下seg(Segmentation)

意思为语义分割, 通俗理解就是把图中的不同物体元素按类别不同,标为不同的颜色,不同的颜色代表不同的元素类别,如下图,左边为原图&a…

Stable Diffuse AI 绘画 之 ControlNet 插件及其对应模型的下载安装

Stable Diffuse AI 绘画 之 ControlNet 插件及其对应模型的下载安装 目录

Stable Diffuse AI 绘画 之 ControlNet 插件及其对应模型的下载安装

一、简单介绍

二、ControlNet 插件下载安装

三、ControlNet 插件模型下载安装

四、ControlNet 插件其他的下载安装方式

五、Co…

Image-to-Image任务的终结者:详解ControlNet原理与代码

Diffusion Models专栏文章汇总:入门与实战 前言:condition diffusion是最火爆的应用方向,2023年效果最好的几种条件diffusion models,例如《详细解读PITI:开启diffusion models image-to-image新时代》、

Stable Diffusion 绘画入门教程(webui)-ControlNet(Tile/Blur)

上篇文章介绍了y语义分割Seg,这篇文章介绍下Tile/Blur(增加/减少细节)

Tile用于增加图片细节,一般用于高清修复,Blur用于减少图片细节(图片模糊),如下图,用Tile做修复&a…

使用ControlNet控制Stable-Diffusion出图人物的姿势

概述

在Stable-Diffusion(以下简称SD)出图中,我们往往需要对出图人物的姿势进行控制,这里我使用一个比较简单上手的方法,通过ControlNet可以很方便地对画面风格,人物姿势进行控制,从而生成更加…

Stable Diffusion 绘画入门教程(webui)-ControlNet(IP2P)

上篇文章介绍了深度Depth,这篇文章介绍下IP2P(InstructP2P), 通俗理解就是图生图,给原有图加一些效果,比如下图,左边为原图,右边为增加了效果的图: 文章目录 一、选大模型二、写提示词三、基础参…

【深度学习】AIGC ,ControlNet 原理,训练,部署,实战

论文:https://arxiv.53yu.com/pdf/2302.05543 代码:https://github.com/lllyasviel/ControlNet

原论文摘录

Introduction

我们提出了一个神经网络结构,ControlNet,来控制预训练的大型扩散模型,以支持额外的输入条件…

![这二维码也太美了吧!利用AI绘画[Stable Diffusion的 ControlNet]生成爆火的艺术风格二维码](https://img-blog.csdnimg.cn/b3da87bca21c473893a4039c113da2a3.png)